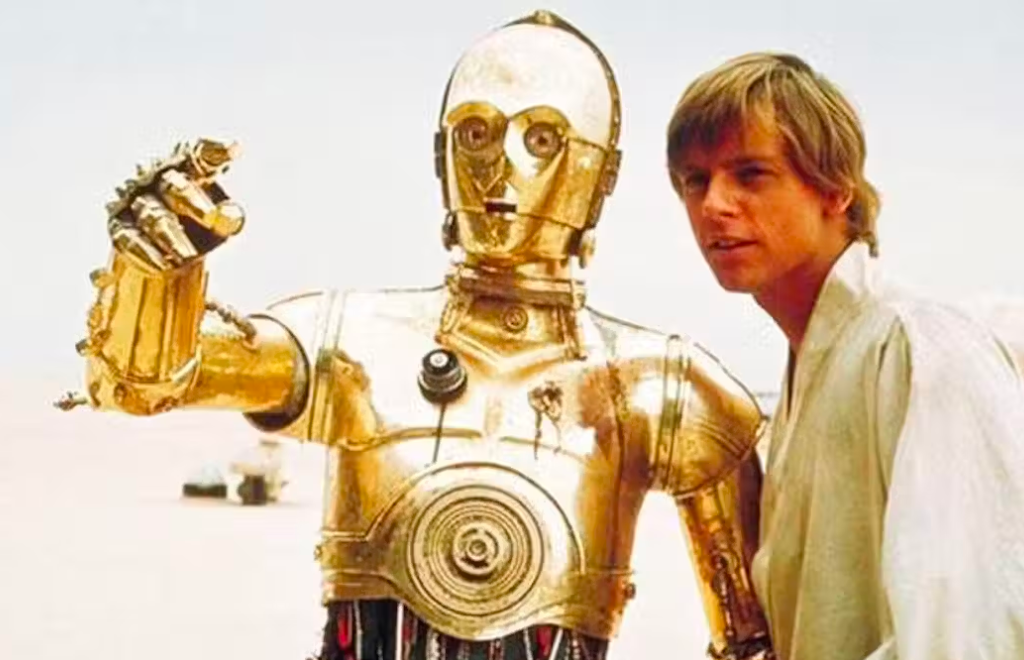

En la ficción no es extraño encontrar la figura del robot asistente. Suele tratarse de un robot humanoide completamente consciente de sí mismo, una especie de robot-sapiens programado para colaborar en ciertas tareas con humanos. Algunos de los más conocidos son C-3PO, de Star Wars, y Baymax, de Big Hero 6.

En estas historias suele haber un elemento común: todos los personajes de la obra aceptan con normalidad esta figura. Por ejemplo, nadie se siente incómodo al lado de Bender en Futurama por el hecho de ser un robot. La integración de los robots en la sociedad es completa y son completamente aceptados. Pero la aprobación social de un robot completamente autónomo y adaptado al entorno social no sería tan fácil de conseguir en el mundo real.

Pongámonos en el caso de que la ficción se hace realidad y el primer robot completamente autónomo y adaptado al entorno social está listo para su inserción en las ciudades. ¿Cómo sería su acogida por parte de los usuarios? ¿Qué aspectos del diseño son claves para mejorar esa recepción?

Comunicación natural

Un aspecto crucial para que la proliferación de estos robots en el día a día tenga una buena acogida es la forma que tendremos de interactuar con ellos. O lo que es lo mismo, la experiencia de usuario. En la ficción, con Bender o C3PO, la comunicación con los autómatas apenas se diferencia de la que se establece entre humanos. Comprenden totalmente lo que le dicen y, aún más importante, se comunican de un modo natural. Eso implica que no hay que usar ningún tipo de interfaz o artificio para charlar con el robot: simplemente hablamos y él capta el mensaje como si fuera una persona más.

Este entendimiento no está tan lejos en la realidad. Probablemente todos hemos hecho uso de tecnologías parecidas: Cortana, Siri y Alexa, los asistentes virtuales más populares, son capaces de realizar una comunicación verbal y mantener una “conversación” sin problemas. Ahora bien, tienen una limitación en su entendimiento, ya que están programados para responder a directrices básicas conocidas.

Por ejemplo, interpretan a la perfección mensajes como “Alexa enciende las luces de la casa” o “Siri, busca en internet la última canción de X artista”. Pero si vamos más allá su rendimiento se ve muy reducido, o incluso dejan de entendernos.

Cuando ChatGPT pueda hablar

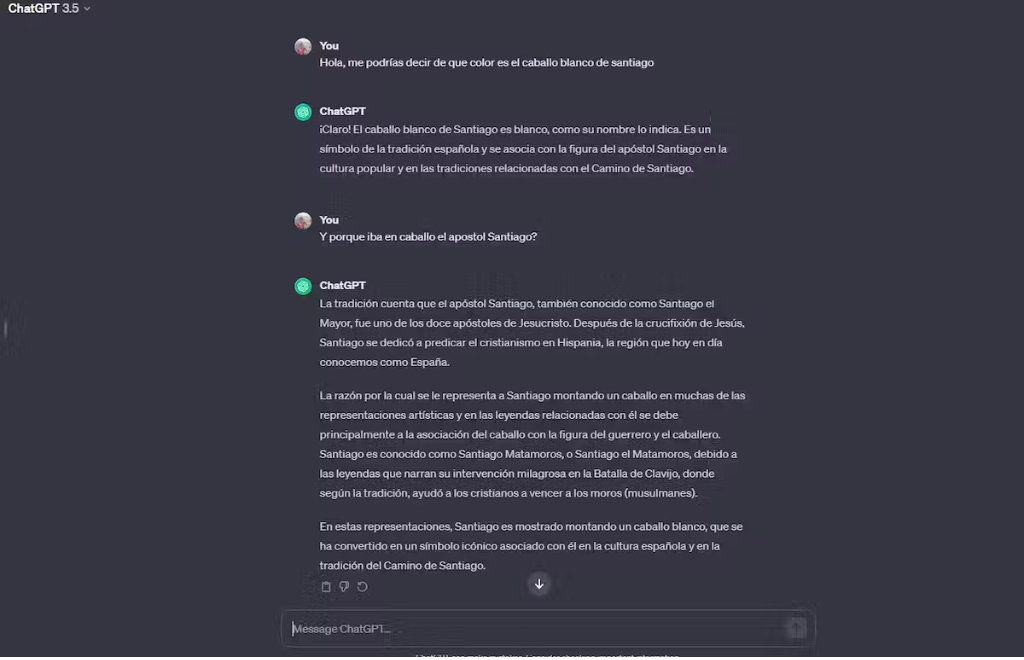

Esta tecnología, que rápidamente se ha insertado en los hogares sin rechazo social, experimentará un gran avance impulsada por inteligencia artificial. La IA permite diseñar y construir modelos que comprendan el lenguaje natural, como ChatGPT o Google Gemini, aparentemente capaces de entendernos casi a la perfección cuando les hacemos preguntas o simplemente conversamos.

Sin embargo, hoy en día la comunicación con esto modelos se lleva a cabo un chat escrito y no la voz. Que ChatGpt hable hará que la comunicación se simplifique y fluya sin restricciones de ningún tipo.

Otra clave de la comunicación humana es la empatía. No hace falta que sea a un nivel avanzado, pero la capacidad de que, mientras una conversación se desarrolla, cambiemos nuestro mensaje o actitud dependiendo de las reacciones que está teniendo el receptor hace de la comunicación algo mucho más natural. Por ejemplo, si nos damos cuenta de que el mensaje que le estamos dando a alguien le esta afectando podemos suavizarlo o cambiar las palabras que usamos.

Mostrar los sentimientos

Rosalind Picard, profesora y directora de un grupo de investigación en el MIT, asegura en su libro Affective Computing que para conseguir una interacción natural con las máquinas, y para que estas sean verdaderamente inteligentes, tendrían que ser capaces de reconocer y entender los sentimientos, e incluso mostrar sentimientos propios.

Este problema está todavía abierto, y es una rama de investigación bastante activa en el campo de la biometría, donde los investigadores se centran en intentar reconocer emociones a través de gestos, tonos de voz y cualquier otra información que acompañe a las palabras.

Aunque todo esto puede sonar a fantasía, en el mundo real ya hay algunos robots sociales funcionando. Y aunque lo hacen en menor escala que en la ficción, trabajan codo con codo con personas y, poco a poco, van entrando en la sociedad.

Un ejemplo de esto es el robot social Pepper, en activo para asistir a niños con deficiencias auditivas. Otro es Stevie, un robot que asistió en una residencia de ancianos, con muy buena acogida entre los residentes.

More photos of @stevietherobot from Reflections.Taking a group for musical bingo,dancing,and falling in love.All in a days work for Stevie. pic.twitter.com/f84Hq89VEB

— Angela Downing (@Reflectionsw) November 21, 2019

Lo más importante para la inserción de ese robot humanoide “perfecto” es conseguir que actúe con total naturalidad con nosotros, que sea capaz de entendernos al hablar y responder adecuadamente, que nos vea enfadados y cambie su actitud, e incluso que muestre felicidad y otros sentimientos humanos.

*José Ignacio Salas Cáceres, Investigador en Ingeniería Computacional, Universidad de Las Palmas de Gran Canaria and Javier Lorenzo Navarro, Associate Professor, Universidad de Las Palmas de Gran Canaria

Este artículo fue publicado originalmente en The Conversation. Lea el original.